Fleiss'in kappa katsayısı

Fleiss'in kappa katsayısı ikiden fazla sabit sayida değerleyici arasındaki karşılaştirmalı uyuşmanın güvenirliğini ölçen bir istatistik yöntemidir.[1]. Fleiss'in kappa ölçüsü sabit sayıda (n tane) değerleyicinin her birinin, (N tane) maddeyi veya kişiyi (C tane) birbirinden karşılıklı hariç olan kategoriye göre ayırmaları süreci sonunda ortaya çıkan değerleyiciler arasındaki uyuşmayı ölçer. Fleiss'in kappa ölçüsü bu uyuşmanın bir şans eseri olabileceğini de ele aldığı için basit yüzde orantı olarak bulunan uyuşmadan daha güçlü bir sonuç verdiği kabul edilir. Ortaya çıkan kategorik değişken olduğu için Fleiss'in kappa katsayısı bir parametrik olmayan istatistik türüdür.

Fleiss'in kappa katsayısı iki değerleyicinin uyuşmaları sorunu inceleyen Scott'un pi katsayısı nın bir genelleştirilmesidir.[2]. Benzer şekilde Cohen'in kappa katsayısına da ilişkilidir.[3]. Ancak Scott'un pi katsayısı ve Cohen'in kappa katsayısı iki değerleyici olması gerektirirken, Fleiss'in kappa katsayisi ikiden daha çok herhangi bir sayıda değerleyici için uygulanabilir. Aynı onlar gibi, yine sabit sayıda değerleyicinin aralarındaki uyuşmanın ne kadar rastgelelik eseri olmadığı ve bu nedenle ne kadar guvenilir olduğunun sayısal olarak 0 ve 1 değerleri arasında ifade edilmektedir.

Açıklamalar

Bu konu şöyle daha genişletilebilir: Sabit n sayıda değerleyici vardır; bunların inceledikleri değerlendikleri haller N sayıdadır; her bir değerleyici her bir hal için k sayıda kategori sayısı verecektir. Eğer bir hal için iki değişik değerleyici aynı kategori sayısı vermişlerse, bu iki değerleyicinin uyuştuğunu gösterir; eğer kategori sayısı değişikse verilen kategori sayıları arasındaki farka dayanarak değişik derecede uyuşmazlık bulunur. Bu uyuşma ya rastgelelik sonucunda doğmuştur yahutta değerleyicilerin inanç ve davranışları birbirine benzemektedir. Fleiss'in kappa katsayısı tek bir hal için iki tane değerleyiciyi değil; n tane değerleyici tarafından N tane hal için yapılan değerlendirmelerle ilgilidir ve bu değerlendirmeler arasındaki uyuşmanın ne derecede rastgelelikten ayrıldığının sayısal ifadesidir.

Fleiss'in kappa katsayısı şöyle tanımlanmıştır:

Burada  faktorü rastgelelik ötesinde ne derece uyuşma olabilmesinin mümkün olduğunu gösterir;

faktorü rastgelelik ötesinde ne derece uyuşma olabilmesinin mümkün olduğunu gösterir;  gözümlenen gerçekte ne derecede rastgelelik ötesinde uyuşma derecesinin ortaya çıktığını açıklar.

gözümlenen gerçekte ne derecede rastgelelik ötesinde uyuşma derecesinin ortaya çıktığını açıklar.

Aşağıda Fleiss'in kappa katsayısını bulmak için hesaplar için örneğinde şu araştırma sorunu ele alınmaktadir:

- Büyük bir psikiyatri kliniği olan bir hastanede 10 hasta için 14 tane doktor ve psikiyatrist tedavi için hastaları 5 kategoride değerlendirmektedirler. Her hasta için her doktor/psikiyatrist beş kategoriden birini seçmektedir. Bu değerlendirmeler bir tabloda aşağıda verilmiştir. Fleiss'in kappa katsayısı bulunup doktor/psikiyatristlerin değerlendirmelerinde kendi aralarında, şans eseri olmayan bir şekilde, ne ölçüde uyuştuklari incelenecektir.

Formüller

N değerlendirilecek hallerin sayısı; n toplam değerleyici sayısı ve k ise degerlemede kullanılacak kategori sayısı olsun. Haller i indeks sayısı ile belirlensin i=1,...,N; değer kategorileri j ile indekslensin j=1,...,k. nij i-inci hali j-inci kategoriye koyan değerleyici sayısını temsil etmektedir.

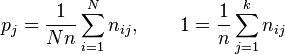

- Önce j-inci kategoriye koyulmuş değerlendirme oranı,

olarak, hesaplanır:

olarak, hesaplanır:

(1)

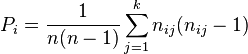

- Sonra i-inci hal için değerleyicilerin ne derece uyuştuklarını gösteren

, hesaplanir:

, hesaplanir:

(2)

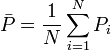

- Simdi

lerin ortalaması olan

lerin ortalaması olan  hesaplanır:

hesaplanır:

(3)

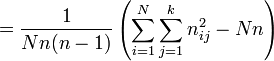

- En son toplam ortalama

olan

olan  hesaplanır:

hesaplanır:

(4)

- Sonuç olarak bunlar yukarıda verilen formüle konulup Fleiss'in kappa katsayısı bulunur:

(5)

Fleiss'in kappa katsayisi için şu değerler hemen yorumlanır:

- κ=1 : Tum değerleyiciler hep birlikte birbirine uyuşmaktadırlar.

- κ=0 : Değerleyiciler aralarinda uyuşmalar sadece şans ile belirlenmiştir ve diğer hallerde hiçbir uyuşma yoktur.

Örneğin

Veri serisi

Yukarıdaki örnekte 14 tane değerleyici (yani n=14), 10 sayıda bir örneklem hallerini (yani N=10) değerlendirip 5 kategoriye (yani k=5) ayırmaktadırlar. Aşağıda örneklem halleri satırlarda ve kategorilerde sütunlarda gösterilmiştir. Burada kullanılan kutuçizim girdileri ve hesap sonuçları verilecektir:

| 1 | 2 | 3 | 4 | 5 |  | |

|---|---|---|---|---|---|---|

| 1 | 0 | 0 | 0 | 0 | 14 | 1.000 |

| 2 | 0 | 2 | 6 | 4 | 2 | 0.253 |

| 3 | 0 | 0 | 3 | 5 | 6 | 0.308 |

| 4 | 0 | 3 | 9 | 2 | 0 | 0.440 |

| 5 | 2 | 2 | 8 | 1 | 1 | 0.330 |

| 6 | 7 | 7 | 0 | 0 | 0 | 0.462 |

| 7 | 3 | 2 | 6 | 3 | 0 | 0.242 |

| 8 | 2 | 5 | 3 | 2 | 2 | 0.176 |

| 9 | 6 | 5 | 2 | 1 | 0 | 0.286 |

| 10 | 0 | 2 | 2 | 3 | 7 | 0.286 |

| Total | 20 | 28 | 39 | 21 | 32 | |

| 0.143 | 0.200 | 0.279 | 0.150 | 0.229 | |

Veri özetleri şunlardır:

= 10,

= 10,  = 14,

= 14,  = 5

= 5

Tüm gözlemler için toplam = 140

için toplam= 3.780

için toplam= 3.780

Formül ve hesaplar

Birinci kategori sütunu toplamı için toplam orantı şöyle bulunur:

İkinci satır hali için toplam orantı şöyle bulunur:

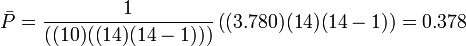

değerini hesaplamak için,

değerini hesaplamak için,  toplamı bulunur:

toplamı bulunur:

Tüm veri serisi ve hesaplama sayfası için

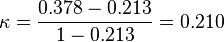

Sonuç olarak Kappa formülü kullanılır:

Sonuç yorumlaması

Landis ve Koch (1977) [4] elde edilen  değerlerini yorumlamak için şu tabloyu sunmuşlardır.

değerlerini yorumlamak için şu tabloyu sunmuşlardır.

| Yorum |

|---|---|

| < 0 | Hiç uyuşma olmaması |

| 0.0 — 0.20 | Önemsiz uyuşma olması |

| 0.21 — 0.40 | Orta derecede uyuşma olması |

| 0.41 — 0.60 | Ekseriyetle uyuşma olması |

| 0.61 — 0.80 | Önemli derecede uyuşma olması |

| 0.81 — 1.00 | Neredeyse mükemmel uyuşma olması |

Verilen örneğinde

bulunduğu için ancak orta dereceli bir uyuşma olduğu sonucu çıkarılabilir.

Ancak bu tabloda verilen yorumlar ve hatta verilen aralıklar hakkında istatistikçiler arasında anlaşmazlık vardır. Landis ve Koch yazılarında verdikleri aralıklar ve yorumlar için teorik delil vermemişlerdir ve bu ifadeler ancak birer şahsi inanç olarak kabul edilebilirler. Bazı istatistikçilere göre bu aralıklar ve yorumlar araştırmacılara zararlı olabilirler.[5] [6]. Bu aralıklar ve yorumlar araştırıcılara Kappa değerinin değişken kategori sayısından da (yani Cden) etkilendiği gerçeğini unutturabilir. Bilinmektedir ki kategori sayısı ne kadar küçük olursa kappa değeri de büyük olmaktadır.

İçsel kaynaklar

Referanslar

- ↑ Fleiss,J.L.(1971) "Measuring nominal scale agreement among many raters." Psychological Bulletin, Cilt 76, Sayi 5 say. 378-382

- ↑

- Scott, W. (1955). "Reliability of content analysis: The case of nominal scale coding." Public Opinion Quarterly, Cilt 19, Sayi 3, say.321-325

- ↑ Cohen, J. (1960), A coefficient of agreement for nominal scales, Educational and Psychological Measurement Cilt 20, Sayi 1, say.37-46

- ↑ Landis, J. R. ve Koch, G. G. (1977) "The measurement of observer agreement for categorical data" , Biometrics. Cilt. 33, say. 159-174

- ↑ Gwet, K. (2001) Statistical Tables for Inter-Rater Agreement. (Gaithersburg : StatAxis Publishing)

- ↑ Sim, J. and Wright, C. C. (2005) "The Kappa Statistic in Reliability Studies: Use, Interpretation, and Sample Size Requirements" in Physical Therapy. Cilt. 85, say. 257--268

Dış bağlantılar

- Kappa: Pros and Cons Katsayı hakkında kapsamlı bir makaleler bibliyografyası vermektedir.